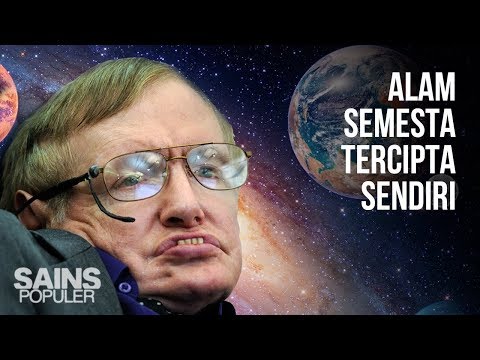

Ahli fizik Inggeris terkenal Stephen Hawking, dalam artikel yang diilhami oleh filem fiksyen ilmiah "Transcendence" yang dibintangi oleh Johnny Depp, mengatakan bahawa meremehkan ancaman dari kecerdasan buatan boleh menjadi kesalahan terbesar dalam sejarah manusia.

Dalam artikel yang dikarang bersama dengan profesor sains komputer Stuart Russell dari University of California di Berkeley dan profesor fizik Max Tegmark dan Frank Wilczek dari MIT, Hawking menunjukkan beberapa kemajuan dalam kecerdasan buatan, mencatat kereta memandu sendiri, pembantu suara Siri, dan superkomputer. pemenang lelaki dalam permainan kuiz TV Jeopardy.

Semua pencapaian ini tidak sesuai dengan latar belakang apa yang menanti kita dalam beberapa dekad yang akan datang. Kejayaan mencipta kecerdasan buatan akan menjadi peristiwa terbesar dalam sejarah manusia. Sayangnya, ini mungkin menjadi yang terakhir, jika kita tidak belajar menghindari risiko,”Hawking dipetik oleh akhbar Britain, The Independent.

Para profesor menulis bahawa pada masa akan datang mungkin tidak ada yang dapat menghentikan mesin dengan kecerdasan tidak berperikemanusiaan dari peningkatan diri. Dan ini akan melancarkan proses apa yang disebut teknologi tunggal, yang bermaksud perkembangan teknologi yang sangat pesat. Dalam filem dengan penyertaan Depp, kata "transendensi" digunakan dalam pengertian ini.

Bayangkan teknologi seperti itu mengatasi manusia dan mendorong pasaran kewangan, penyelidikan saintifik, manusia, dan pengembangan senjata di luar pemahaman kita. Sekiranya kesan jangka pendek kecerdasan buatan bergantung pada siapa yang mengendalikannya, maka kesan jangka panjang bergantung pada sama ada ia dapat dikawal sama sekali.

Sukar untuk mengatakan apa akibatnya kecerdasan buatan terhadap manusia. Hawking percaya bahawa terdapat sedikit penyelidikan serius yang dikhaskan untuk isu-isu ini di luar organisasi bukan keuntungan seperti Pusat Cambridge untuk Kajian Risiko Eksistensi, Institut untuk Masa Depan Kemanusiaan, dan institusi penyelidikan untuk kecerdasan mesin dan kehidupan masa depan.

Menurutnya, kita masing-masing harus bertanya kepada diri sendiri apa yang dapat kita lakukan sekarang untuk mengelakkan senario terburuk di masa depan.